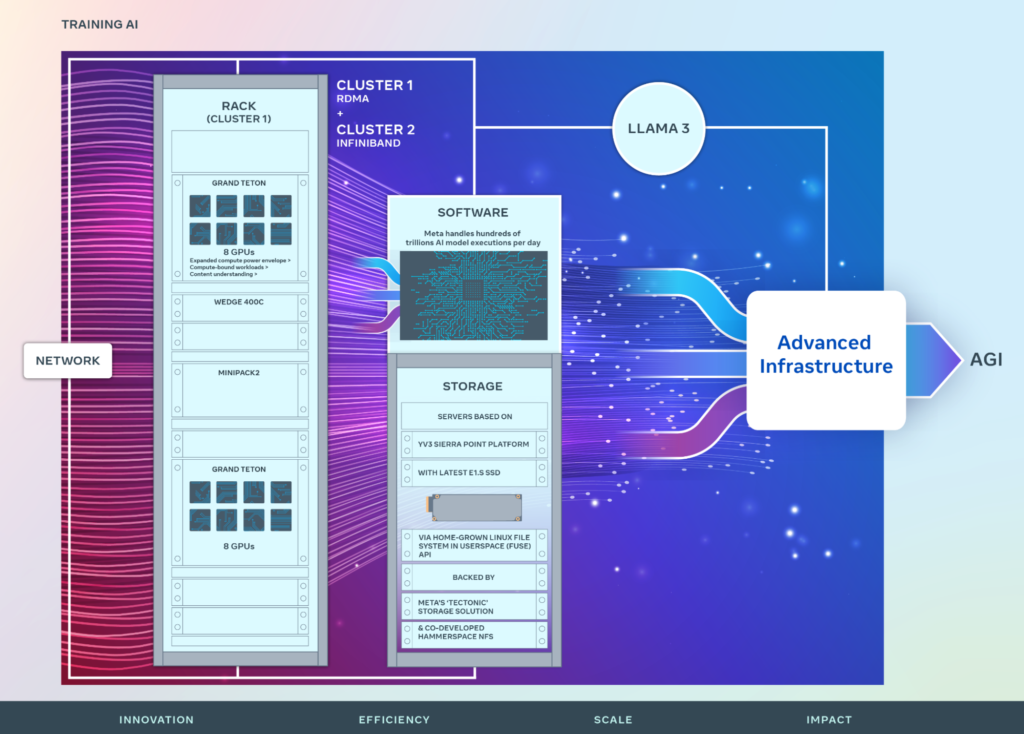

Meta 正在打造一套超大规模的人工智能计算平台,他们宣布推出了两个包含 24000GPU 的集群。这些不是普通的计算资源,而是高端的 NVIDIA H100 GPUs,这些集群专为 AI 工作负载设计,以实现高吞吐量和可靠性。预计到 2024 年底,Meta 计划将这些资源扩展到惊人的 350000 个 GPU,这将提供相当于近 600,000 H100 的计算能力。

这项投资的目的不仅仅是为了增加计算力。Meta 还采用了开放的设计哲学,利用了开源技术,如 Grand Teton 硬件平台、OpenRack 服务器架构和 PyTorch 深度学习框架,这意味着他们正在推动整个行业的技术进步,而不仅仅是自家的发展。