字节跳动今天发布一些列新的模型。包括音乐模型,同声传译模型、文生图2.0模型、新的基于DIT的视频生成模型、豆包通用模型pro、语音合成模型。

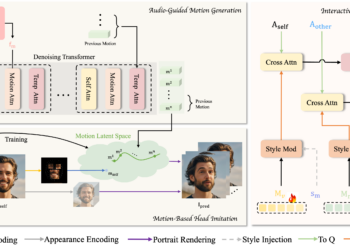

还发布了图像转视频口型同步模型和文本、音频驱动的数字人模型。

这些功能将全部集成到最新版的豆包、即梦AI和剪映中…

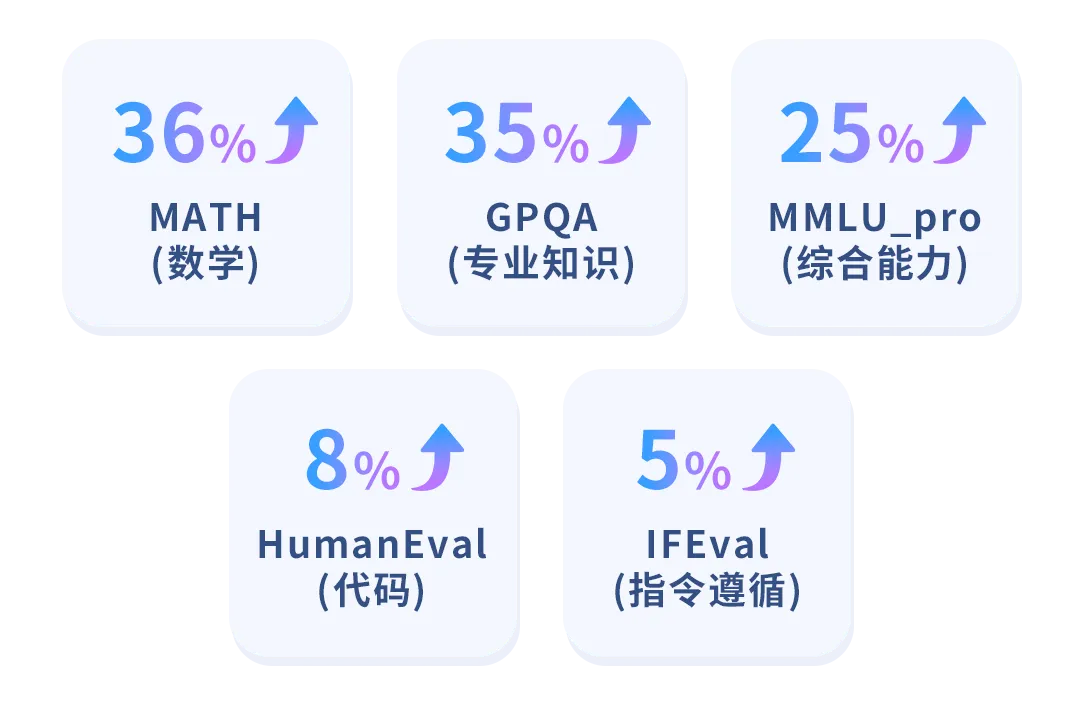

其中,主力模型“豆包通用模型pro”最新版本在各维度上国内领先。

截至到9月,豆包大模型的日均 tokens 使用量已经超过1.3万亿,4个月的时间里 tokens 整体增长超过了10倍。在多模态方面,豆包·文生图模型日均生成图片5,000万张,此外,豆包目前日均处理语音85万小时。

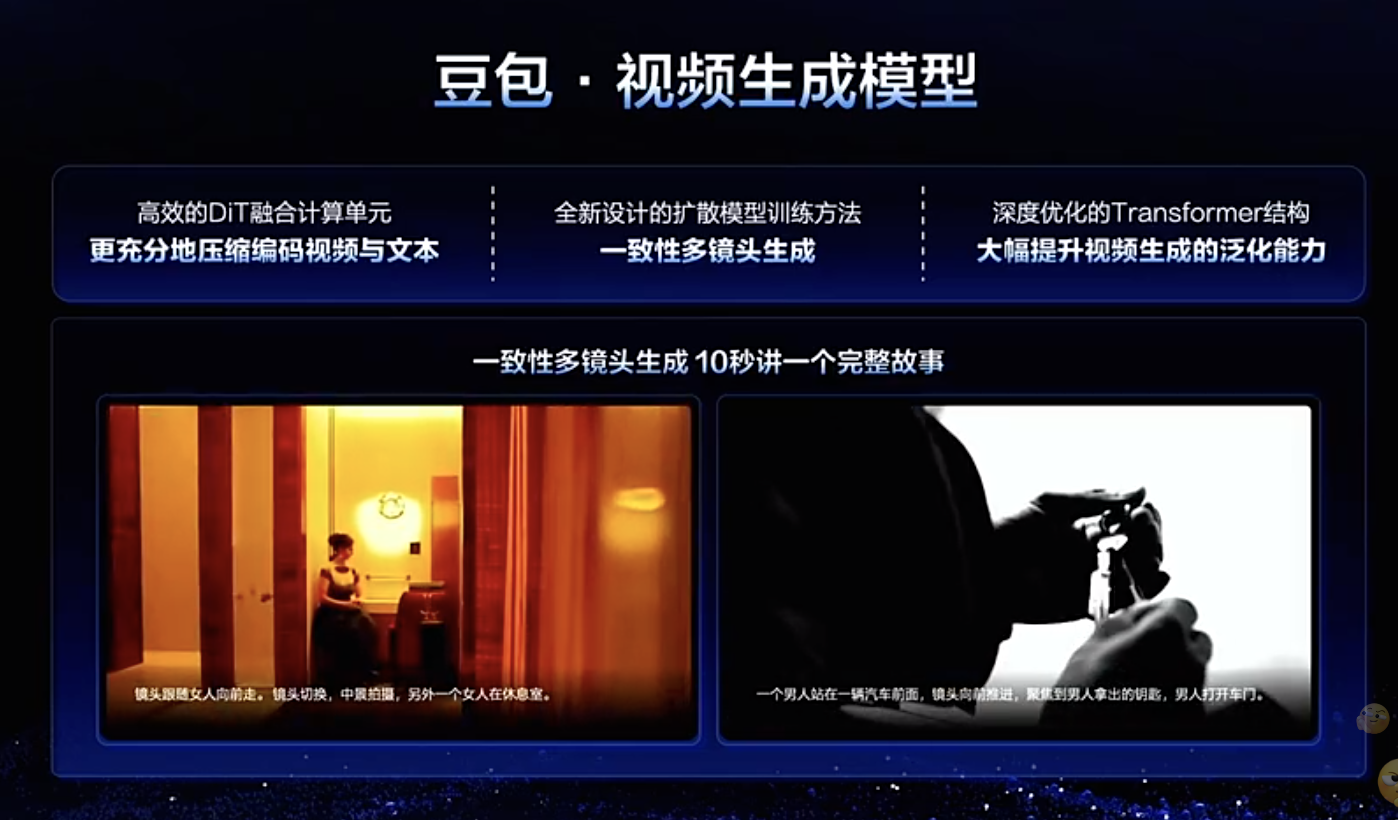

截至到9月,豆包大模型的日均 tokens 使用量已经超过1.3万亿,4个月的时间里 tokens 整体增长超过了10倍。在多模态方面,豆包·文生图模型日均生成图片5,000万张,此外,豆包目前日均处理语音85万小时。豆包·视频生成模型:

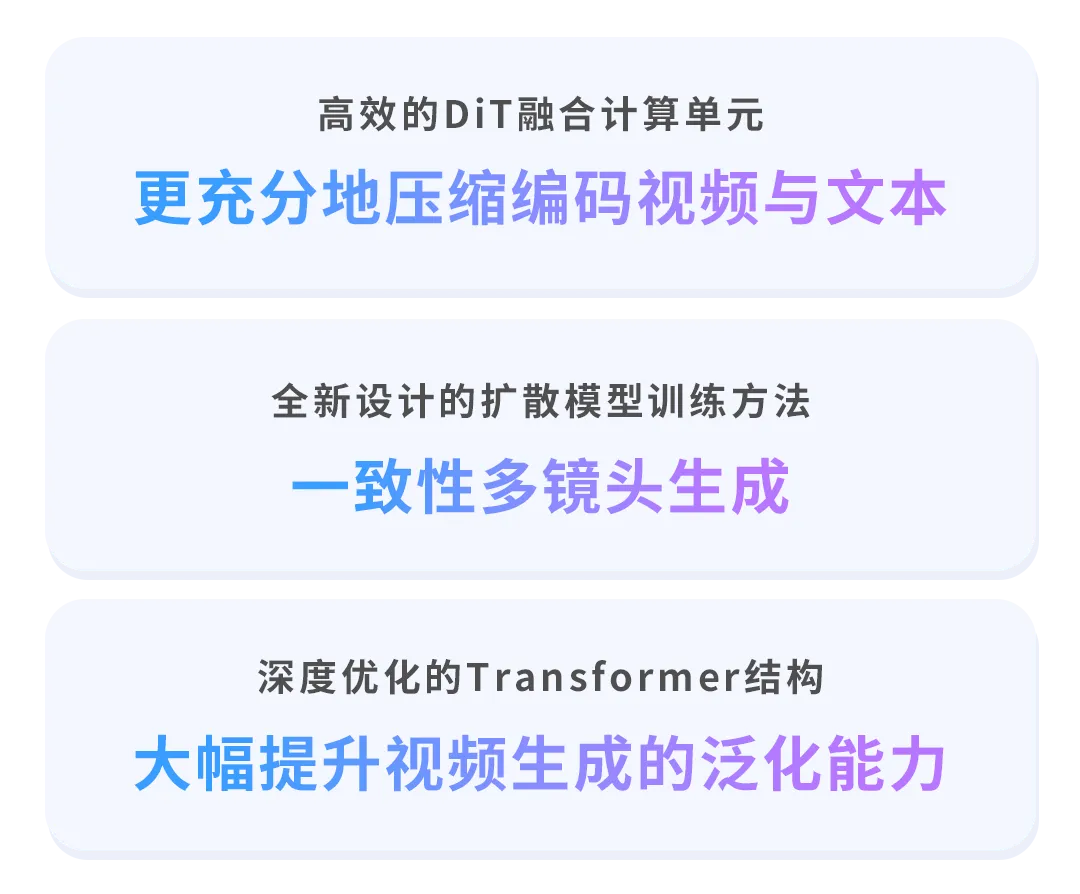

基于DIT架构的视频生成模型

豆包视频模型包括 PixelDance 模型和 Seaweed 模型两种。

豆包视频生成模型能够实现复杂的多主体互动。这意味着多个视频中的人物可以在不同镜头中自然地完成复杂的互动动作,人物的样貌、服装和细节在不同镜头的切换下仍然保持一致,接近真实拍摄的效果。

这种一致性得益于 DiT架构(融合计算单元)的应用,使得视频生成在动态和运镜之间可以灵活切换,支持多种镜头语言,如变焦、环绕、平摇、缩放、目标跟随等。

- 精准的语义理解:模型能够理解复杂的用户指令(prompt),生成多个动作和主体之间的交互视频。可以处理具有时间顺序和复杂结构的任务,如生成时序性动作和多个主体互动的场景。

- 强大的动态表现和镜头切换:

- 豆包·视频生成模型突破了传统PPT动画的局限,能够生成流畅的动态视频,并支持复杂的镜头操作,如变焦、环绕、平摇、缩放和目标跟踪等。

- 模型具备灵活的视角控制能力,带来更贴近现实的视觉体验,能够在不同场景中轻松切换镜头。

- 多镜头一致性:

- 模型解决了多镜头切换时的一致性问题,支持在一个 prompt 中实现多个镜头的平滑切换,同时保持主体、风格和氛围的一致性。它可以在短短10秒内生成一个完整故事的视频,从而大幅提升生成视频的叙事能力。

- PixelDance模型成功攻克了多镜头切换时难以保持一致性的困扰,可10秒讲述一个起承转合的故事。在一个prompt的多个镜头切换时,保持主体,风格,氛围和逻辑的一致性,实现导演自由。

以上视频来自卡兹克授权发布

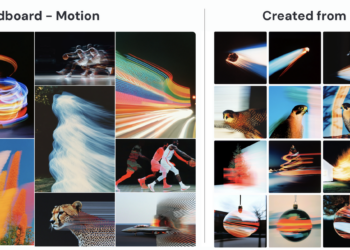

- 高保真和多风格支持:

- 豆包·视频生成模型支持多种视频风格,包括黑白风格、3D动画、2D动画、国画等多种表现形式。画面比例方面,模型支持1:1、3:4、4:3、16:9、9:16、21:9六种比例,适应不同终端设备和需求,如手机竖屏、电影画幅等。

- 通过高保真的图像质量,模型能够为生成的视频提供卓越的视觉效果。

应用场景:

- 电商营销:

- 豆包视频生成模型能够快速生成3D动态商品展示,支持根据节日、主题替换背景和风格,生成不同尺寸的营销视频,提升电商企业的营销效率。

- 动画教育:

- 模型可以大幅降低动画制作成本,使得教育场景中的童话故事和互动内容更加生动、真实。

- 城市文旅、微电影、音乐MV:

- 豆包模型可应用于城市宣传、文旅营销和短片制作,通过高效生成多风格视频,大幅提升创意内容的制作效率。

一些其他案例

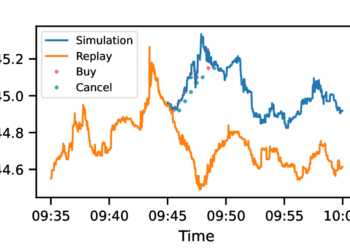

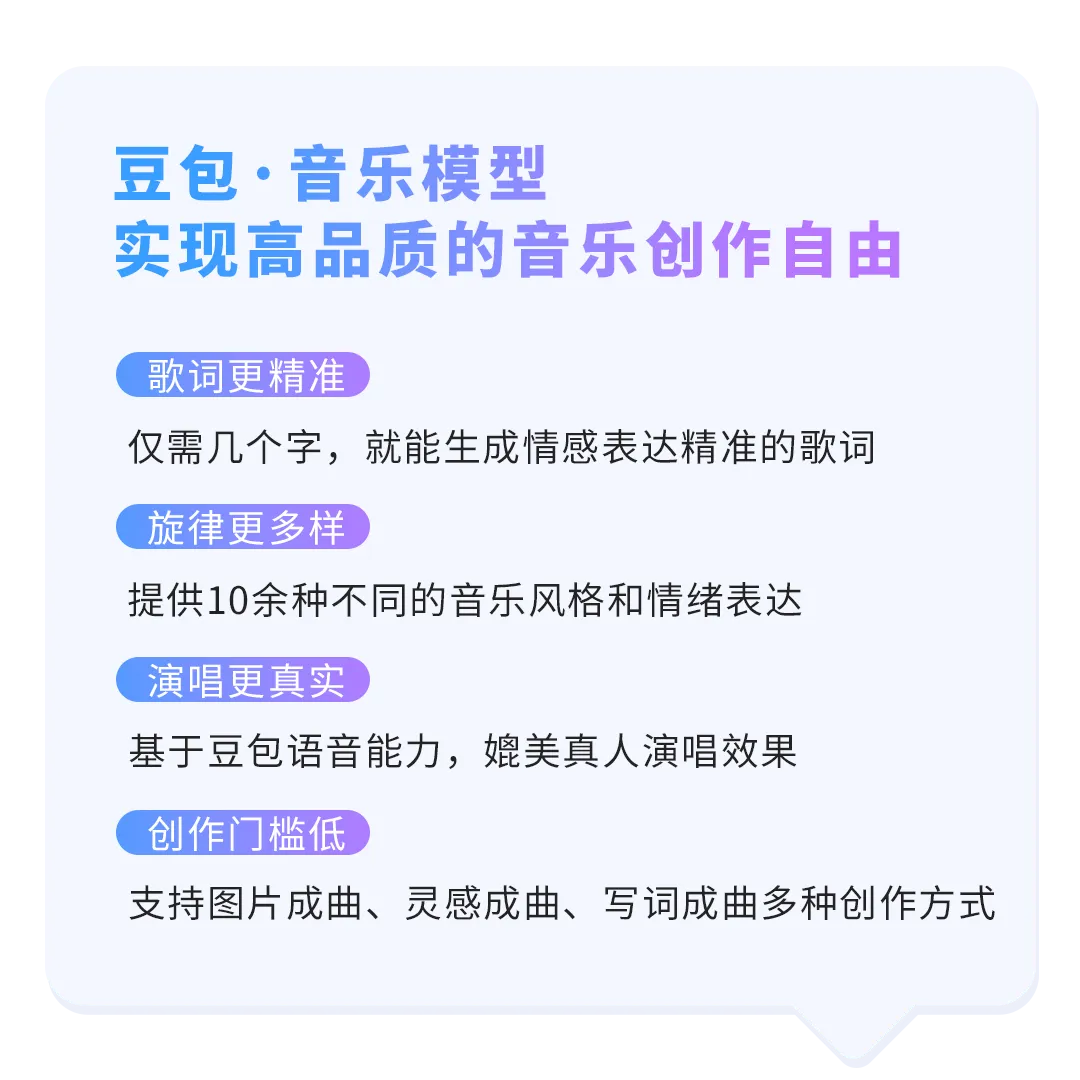

豆包·音乐模型:

能够生成高质量的音乐作品,为音乐创作提供便利。

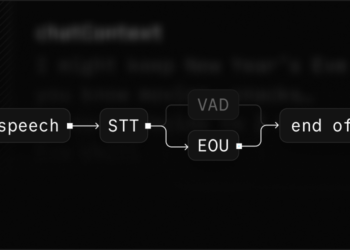

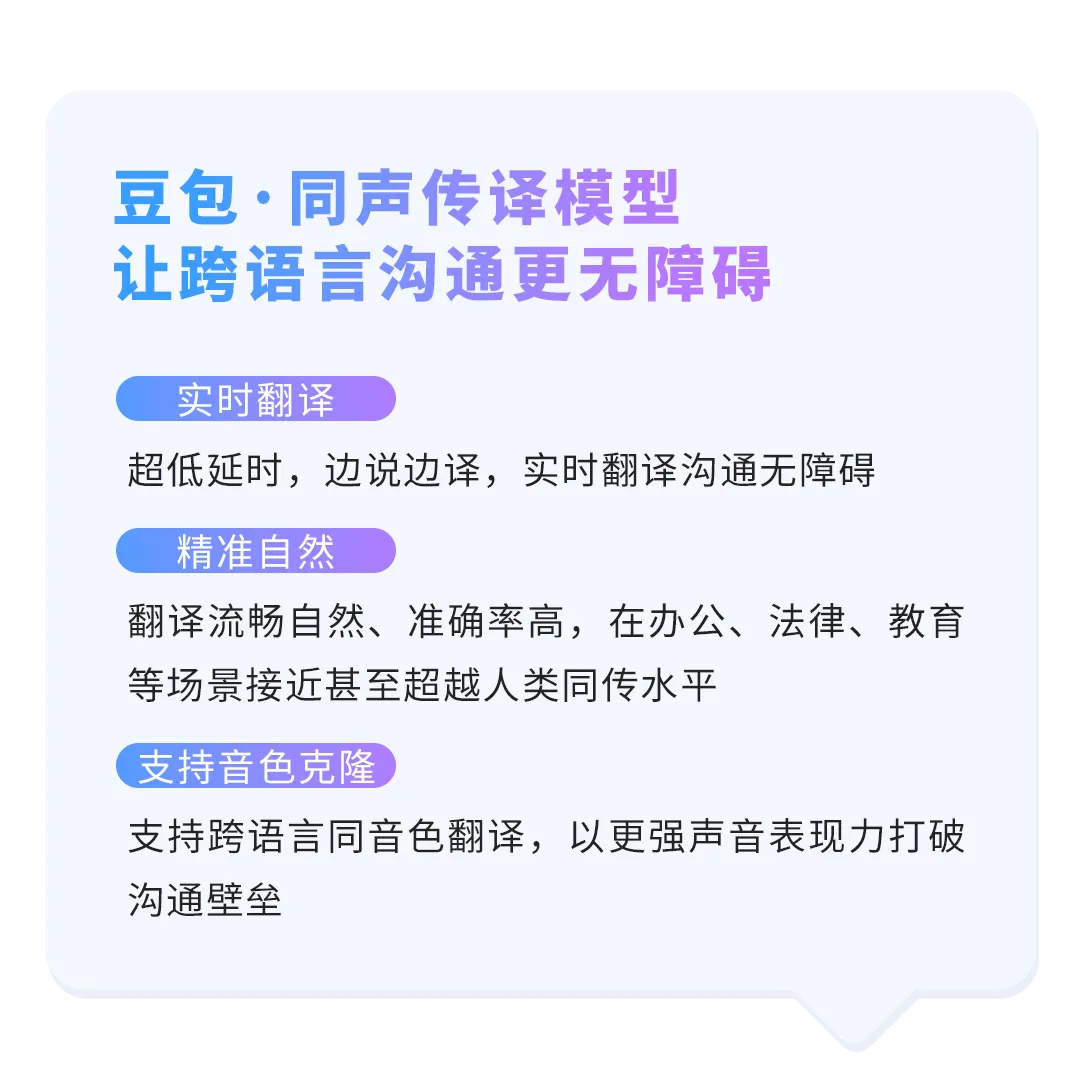

豆包·同声传译模型:

支持多语言的实时同声传译,进一步增强了语言模型在跨语言场景中的应用能力。

豆包视频模型体验地址:https://jimeng.jianying.com/ai-tool/video/generate