BlenderAlchemy 是一个创新的系统,由斯坦福大学开发,旨在通过视觉语言模型(如 GPT-4V)在 Blender 3D 图形设计环境中进行编辑操作。该系统利用视觉语言模型的视觉-语言理解技术,将用户的文本或图像意图转化为对 Blender 工作环境的具体编辑操作。通过这种方式,BlenderAlchemy 可以自动化并简化在 Blender 中进行的繁琐和复杂的设计任务。

也就是允许通过聊天形式来进行3D图形编辑。这意味着设计师可以使用文字描述或提供图片来表达他们对场景的具体需求,例如修改材料属性、调整光照设置或改变对象的位置。BlenderAlchemy 利用强大的视觉语言模型来理解这些描述,并自动将这些意图转换成实际的编辑操作。

这种方法的好处在于,它让设计过程变得更直观和互动,设计师不必深入学习复杂的软件操作细节,只需描述他们想要的效果,BlenderAlchemy 就能自动完成具体的设计任务。这种方式类似于与一个理解3D设计的智能助手对话,它能理解你的需求并快速响应,大大提升设计效率和创造力的发挥。

主要功能

BlenderAlchemy的核心功能集成了多种先进的技术,以支持复杂的3D设计任务在Blender软件中的自动化执行。以下是更详细的介绍,突出了每个主要功能的技术细节和操作流程:

1. 智能文本指令解析

- 功能描述: BlenderAlchemy 使用自然语言处理技术,解析用户通过文本形式输入的设计指令。系统能够理解从简单的指令(如“增加亮度”)到复杂的请求(如“模拟夕阳的照明效果”)。

- 利用视觉语言模型(如GPT-4V),该模型经过特别训练,可以理解与3D设计相关的语言表达,并将这些表达转化为具体的Blender操作指令。

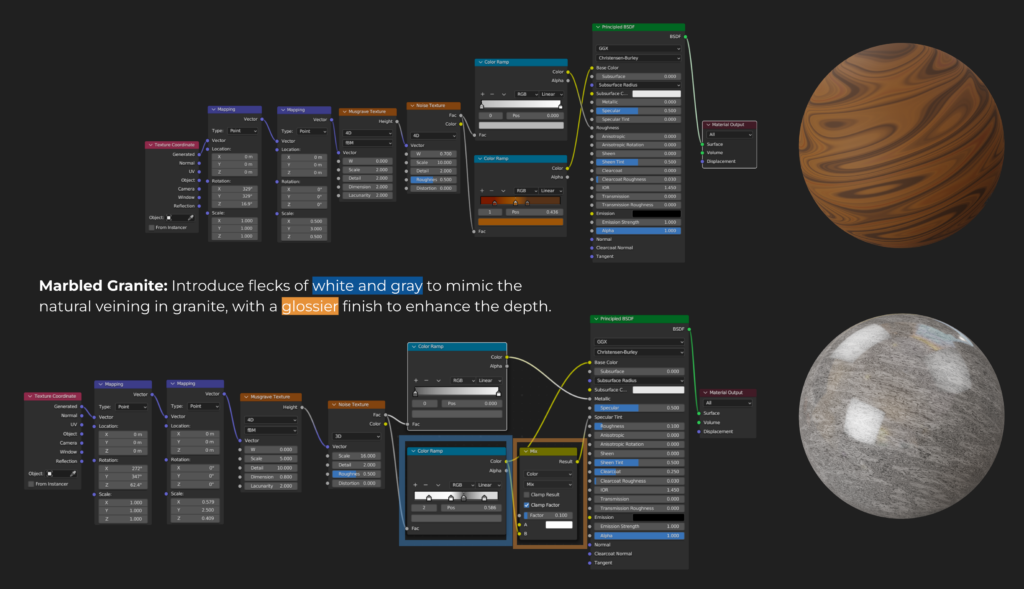

- 这意味着设计师可以仅通过描述他们想要的效果,来指示系统进行特定的设计调整。例如,如果一个设计师想要改变一个物体的材质,他们可以输入“将前台接待台的材质改为大理石样式”。BlenderAlchemy将自动识别和应用大理石材质到相应的模型部分。

2. 图像引导的场景编辑

- 功能描述: 用户可以上传图片作为设计参考,BlenderAlchemy 分析这些图片,并应用相似的视觉效果到当前的3D场景中。

- 技术实现: 结合图像识别和图像生成技术,如使用改进的DALL-E模型,这使系统不仅能识别上传图片中的关键视觉元素,还能创造性地在Blender场景中重现这些元素。

- 例如:设计师可以上传一张他们喜欢的场景照片,比如一个具有特定光照和氛围的室内照片,并指示BlenderAlchemy复现相似的光照和氛围。系统将分析图片中的光照条件和颜色,并自动调整3D场景以匹配上传的图片。

3. 迭代编辑与优化

- 功能描述: 系统通过一个迭代过程不断调整3D场景,以达到用户的设计目标。每次编辑后,系统评估更改并提供视觉反馈。

- 在设计过程中,BlenderAlchemy提供了一个迭代优化功能,允许用户连续调整设计直到满意为止。例如,在设计一个室内场景时,系统可以提供多个光照和材质的组合选项,用户可以预览每个选项并选择最符合他们愿望的一个,系统再基于选择继续优化其他元素。

4. 实时设计反馈与交互

- 功能描述: 设计师可以在设计过程中实时看到每一步的效果,根据预览结果提供反馈,系统据此调整后续操作。

- BlenderAlchemy 设计了一个直观的用户交互界面,使设计师可以轻松地输入他们的设计要求,并查看系统生成的编辑和最终结果。界面支持实时反馈,用户可以随时调整他们的输入或直接与生成的设计进行交互。

- 在任何时候,设计师都可以获得对当前设计状态的实时视觉反馈。如果正在设计一个复杂的场景布局,系统可以即时渲染出当前的布局效果,设计师可以立即看到他们所做的每一个调整的影响。

5. 多模态设计输入

- 功能描述: 支持多种输入模式,包括文本、图像、声音等,为设计师提供多样化的表达方式。

- 通过多模态数据处理技术,系统能够同时处理和解析不同类型的输入,提高用户与系统之间的互动性和灵活性。例如,设计师可以通过说出命令来调整场景的视角或是更改对象的颜色。

6. 复杂视觉内容的理解与生成

- 功能描述: 利用深度学习模型和计算机视觉算法,如图像分割、对象识别和3D模型生成,来处理和创造复杂的视觉内容系统能够理解复杂的视觉内容,并在必要时生成新的视觉元素以满足设计需求。

- 系统不仅能够理解用户的指令,还能够创造和调整场景中不存在的内容。例如,如果设计师想要在场景中添加一个不存在的对象,比如一个古董花瓶,系统可以生成一个花瓶的3D模型并将其加入到场景中。

7. 设计项目的预览与审查

- 功能描述: 在设计完成前,提供多个视角和详细层级的预览,允许设计师进行全面审查并进行细节调整。

- 通过集成高质量的3D渲染技术,使设计师可以在不同的光照、材质和视角下审查设计效果,确保最终输出的高质量。

- 在项目完成前,设计师可以进行一次全面的审查,系统提供详细的各个角度的渲染图,设计师可以从中找出需要进一步调整的细节。例如,在一个房间的设计完成前,系统可以提供从不同光源角度照亮的房间图片,帮助设计师决定最终的光照设置。

8.整合多种编辑工具

- BlenderAlchemy 能整合和利用现有的多种编辑工具和技术,提供一种灵活而强大的方式来达成设计目标。

- 除了Blender的内置工具,BlenderAlchemy还支持与第三方插件和扩展的整合,如流行的渲染引擎Cycles和Eevee。这种整合扩展了系统的功能,允许用户利用这些高级工具来实现更专业的视觉效果和渲染质量。

- BlenderAlchemy可以与图像处理软件如Photoshop或GIMP协同工作,将这些软件的图像编辑功能集成到3D设计流程中。例如,可以自动将Blender场景的渲染输出发送到Photoshop进行后期处理,或者利用GIMP生成的纹理直接应用于Blender模型。