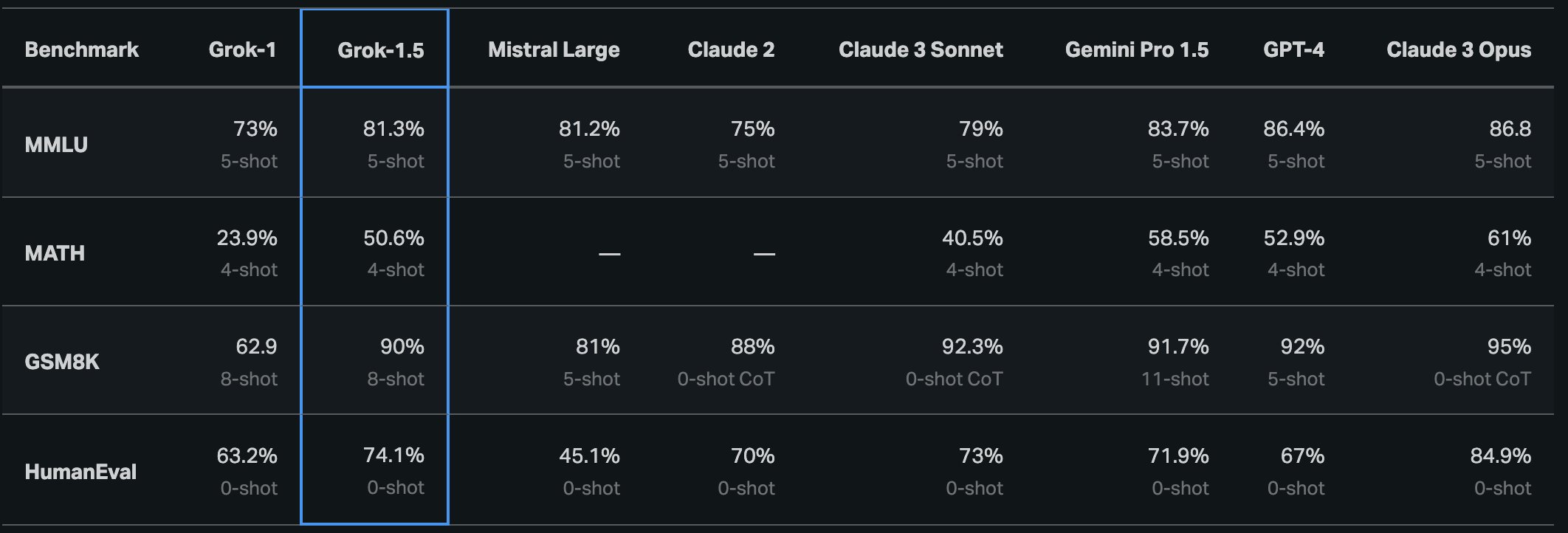

X.AI 宣布推出了:Grok-1.5 模型,具备长文本理解和高级推理能力。它将在未来几天内向早期测试者和现有Grok用户开放。Grok-1.5相较于之前版本在编程和数学相关任务上表现出显著的进步,其在MATH基准测试中得分为50.6%,在GSM8K基准测试中得分为90%,这两个测试覆盖了从小学到高中竞赛问题的广泛范围。此外,它在HumanEval基准测试中得分为74.1%,后者评估代码生成和问题解决能力。

128k 上下文长度

即将在𝕏上进行提供

- Grok-1.5在MATH基准测试中取得了50.6%的成绩,比上一代提高一倍,逼近GPT 4等模型。

- HumanEval基准测试:得分74.1%,由于除Claude 3 Opus的所有模型。

- 在GSM8K基准测试中取得了90%的成绩,优于 Mistral Large、Claude 2。

- MMLU测试中:取得了81.3%的成绩,这表明模型在理解广泛的语言任务方面能力增强。

- Grok-1.5展现了强大的文本内嵌检索能力,能够在高达128K标记长度的文本中实现完美检索。

Grok-1.5建立在一个基于JAX、Rust和Kubernetes的自定义分布式训练框架之上,提供了强大的灵活性和可扩展性。

-

自定义分布式训练框架:Grok-1.5使用了一套特别设计的系统,允许模型在多个计算节点上同时训练,这有助于处理更大的数据集,提高训练速度和效率。

-

灵活性和可扩展性:使用这些技术的组合,Grok-1.5的训练框架能够适应不同的训练需求和规模,能够随着需要轻松地增加或减少资源。